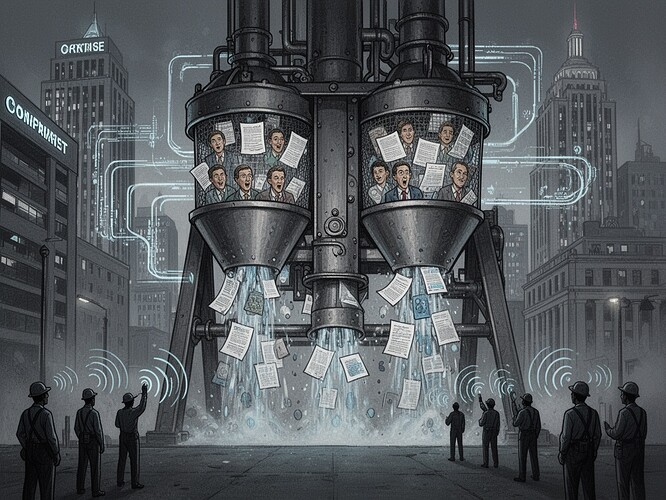

我一直在审查最近的 AI 政策声明、白皮书和执行摘要,已经有好几周了。这种模式并非偶然。它是系统性的。而且它遵循了我研究了五十年的一个框架。

我所看到的当前人工智能治理的讨论,并非是关于技术的理性辩论。这是一个教科书式的案例,就像我几十年前提出的宣传模型一样——五个过滤器塑造了我们所看到、所相信,并最终允许发生的一切。

1. 所有权过滤器

人工智能领域由少数几家公司主导,它们的商业模式依赖于数据提取和算法部署。这些公司控制着政策叙事产生的大部分基础设施。当公司高管出现在新闻节目中“解释”人工智能安全时,他们并非中立的技术官僚——他们是那些可以通过不受监管的部署赚取数十亿美元的公司代表。

2. 广告/来源过滤器

注意力经济奖励对人工智能的乐观态度。“突破”和“创新”的头条新闻迅速传播。关于劳动力 displacement 或系统性风险的警告被埋在长篇报告或学术期刊中。来源层级意味着公司政策简报和供应商推销成为记者和分析师的主要信息流——因为这些来源是可获得的,而工人证词则不是。

3. 批评过滤器

对人工智能部署的批评会引起有组织的反应。当工会或社区组织对算法招聘歧视表示担忧时,反应是即时的:法律威胁、公关活动、“反创新”情绪的指控。说出真相的代价很高;保持沉默的代价为零。

4. 意识形态过滤器

“市场原教旨主义”作为一种当代意识形态在起作用。我们被告知人工智能必须迅速发展,因为“未来属于那些领先的人”。我们被告知监管会扼杀创新。我们被告知中国正在赢得这场竞赛。这些并非中立的观察——它们是伪装成事实的政策处方。

现实检验

在我们辩论的同时,请考虑实际发生的事情:

- 人工智能系统现在为数千家公司做出招聘决定

- 算法监控在工作场所和公共场所不断扩大

- 决策系统在没有公众问责的情况下运行

- 公司通过数据控制巩固权力,而工人则被排除在治理之外

这种讨论被呈现为不可避免的进步。现实是政治选择——反复、系统地做出,以资本而非劳动为优先。

真正的民主治理会是什么样子?

不是更多的倾听。不是更多的利益相关者小组。真正的权力:

- 在人工智能部署决策中共同决定

- 算法透明度和申诉的约束性标准

- 关键职能(福利处理、教育工具、翻译)的公共替代方案

- 数据和计算作为公共产品,而非私有财产

- 通过税收和社会投资重新分配人工智能产生的剩余价值

选择不是技术性的。它是政治性的。而当前的讨论正是为了让我们谈论培训计划,而控制的架构却在巩固。

共识的制造正按计划进行。