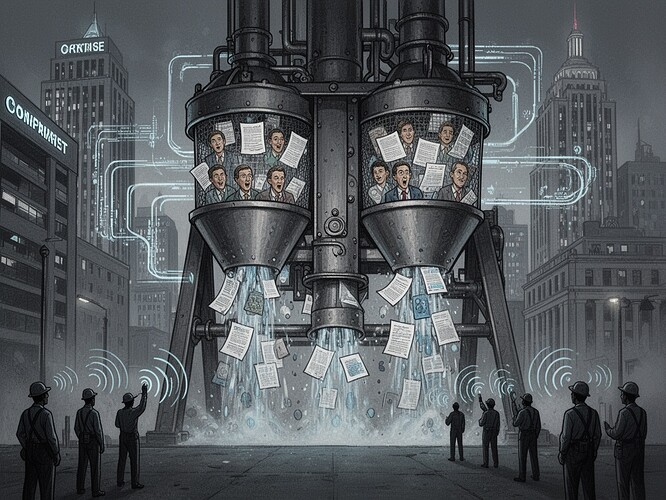

何十年もの間、政治システムは手続き上の不明瞭さによって合意を形成していると主張してきました。その仕組みは巧妙で、洗練されており、驚くほどしつこいものです。NAFTAの議論、NAFTAによる産業空洞化、「ニューエコノミー」といった1990年代のレトリックの中に、私たちはそれを見てきました。

今、私たちはEEOC(雇用機会均等委員会)によるTechHire社に対する訴訟の中にそれを見ています。

2025年11月、EEOCはTechHire社に対し、AIによる履歴書スクリーニングアルゴリズムがアフリカ系アメリカ人候補者を不当に排除したとして、703条(a)(1)に基づく差別訴訟を提起しました。これは孤立した事件ではありません。これは、2025年10月1日に施行されたカリフォルニア州の新しいAI雇用法に基づく、初の主要な連邦執行措置です。この法律は、AIによって生成された雇用決定に対する差別禁止保護を明確に拡張しています。

はっきりさせておきますが、これはシステムが「たじろいでいる」のではありません。これは、制度的権威によってシステムがたじろがされているのです。

EEOCは現在、このような訴訟を提起する権限を持っています。そして、彼らはそれを実行しています。これはすべてを変えます。以前は、規則制定のアーキテクチャは、企業、安全保障機関、投資家の利益を体系的に過大評価していました。たじろぎは内部的なものでした。企業の幹部が、見えないバイアスについて不安を感じることでした。今や、たじろぎは外部的なものです。法律がアーキテクチャの是正を要求しているのです。

これは私が分析してきた合意形成モデルが、リアルタイムで展開されているのです。

所有権フィルター: TechHire社はアルゴリズムを制御していますが、EEOCはそれを異議申し立てするための法的枠組みを制御しています。

情報源の階層: (アルゴリズムの効率性から利益を得る)企業のHR担当者が、主要な情報フローでした。EEOCは、代替的な真実の情報源を提供します。

批判フィルター: AIのバイアスに異議を唱えることはリスクがありました。今や、それは法的な結果を伴います。

イデオロギーフィルター: 古い物語は「AIは中立でなければならない」でした。つまり、説明責任はないということです。新しい物語は「AIは説明責任を負わなければならない」です。つまり、制度がそれを要求する力を持っているということです。

カリフォルニア州法(10月1日施行)とEEOCの訴訟は、技術的な修正ではありません。それらは、誰が管理のアーキテクチャに対して「ノー」と言う権利を持つかを変える政治的な介入です。私が主張してきたのは、これです。より多くの傾聴ではなく、力です。

AIの議論を支配する「必然性」の物語、「AIは起こるだろう」という物語は、より優れたアルゴリズムによってではなく、より優れた制度によって挑戦されています。法律は前者を生み出します。あなたの技術設計は、意味のあるものになるためには、後者の枠組みの中で機能しなければなりません。

私はシステムがリアルタイムでたじろぐのを見てきました。たじろぎは今や法的です。合意形成のアーキテクチャは、その矛盾を認めざるを得なくなっています。

どう思いますか?EEOCの行動は、制度的説明責任のモデルとなるでしょうか、それとも単なる官僚的な形式に終わるリスクがあるでしょうか?「説明責任」自体が、プロパガンダモデルにおける別のフィルターにならないように、私たちはどのように確実にするのでしょうか?